“元宇宙”要来了,我们可以信任AI吗?发表时间:2021-11-19 14:51 来源:第一财经 人工智能的发展趋势是人机合作 目前,人工智能在各行各业的商业应用方兴未艾。现有研究和案例总结得出,在部分应用场景下,人工智能可直接替代人工,而在更多复杂的场景中则以辅助人类决策的形式出现。 现有的实践经验表明,简单任务场景下人工智能直接替代人工可极大提升生产率。例如,零售业企业可以用刷脸支付替代收银员。某零售商的数据显示,一台刷脸支付机器相当于1.5个收银柜台,按早晚班计算,可以减少3个收银员的人力成本,集团每年可节省1344万元。 随着人工智能在业界应用的兴起,很多学者开始关注其对劳动力市场的影响。学术研究通过比照真实的人工决策和人工智能决策数据,更为具体地衡量了在不同任务下人工智能与人类决策质量的差距。例如,对比人工智能和法官对被逮捕的犯罪嫌疑人是否可以保释的决策,发现人工智能可以很大程度上超越人类法官的决策水平,在审前羁押率不变的情况下,让犯罪率下降24.7%。 在更为复杂的、尤其是涉及大量人际交互的场景中,人工智能更多以辅助人类决策的角色出现。例如,在互联网金融中,贷款催收的痛点之一在于单笔额度较低,回款成本较高。借助人工智能技术,互联网金融公司可以依托大数据和机器学习建模,对客户的还款意愿进行分层打分,并提供相应的催收手段和策略。对于还款意愿高的客户,采用提醒版催收话术;对于还款意愿中等的客户,前期使用催收机器人,后期根据催收机器人反馈结果转人工处理;对于还款意愿低的客户,直接转人工处理。据某互联网金融公司统计,通过这一方式,综合回收率可提升5%以上,并且能节省40%的人力成本。 人工智能辅助人类决策效率最高 该研究还希望进一步理解引入人工智能辅助人类决策对劳动力市场效率和平等的影响。研究团队基于某公司的历史现金贷实际数据进行了研究,对比三种情形下的贷款审批决策的效果:人类单独决策、人类-人工智能合作决策、人工智能单独决策。在人类决策组,决策者看到贷款者的背景信息,并独立做出贷款决策;在人类-人工智能合作决策组,人工智能为决策者提供贷款者基于背景信息判定的“还款分”,决策者根据贷款者的还款分和其他背景信息,综合做出贷款决策;在人工智能决策组,贷款决策完全由人工智能完成。然后我们用贷款者的真实历史表现衡量上述三组的贷款决策质量,并分析其中的决策机制。 图1 人类决策组、人类—人工智能决策组、人工智能决策组对比  如图1最左侧所示,人类决策组、人类-人工智能合作决策组、人工智能决策组的准确率分别是62.4%、70.6%和 84.7%,并在统计上有显著差异。人类-人工智能合作决策组相比于人类决策组,准确率提高了13.3%,提升程度非常可观。 此外,也可观察到三个决策组都出现了不同程度的决策错误,其决策错误可以进一步分为:一类错误——“错误地拒绝了实际还款的人(没借钱给能还款的人)”和二类错误——“错误地接受了实际未还款的人(借钱给了还不起款的人)”两类错误。图1中间和右侧两列展示了这两类决策错误的占比。人类-人工智能合作决策组相比于人类决策组,在两类错误方面都有所降低。有趣的是,人类-人工智能合作决策组相比于人工智能决策组,仅仅在“错误地拒绝了实际还款的人(没借钱给能还款的人)”方面落了下风(人工智能决策组仅为3.5%),而在“错误地接受了实际未还款的人(借钱给了还不起款的人)”比人工智能单独决策表现更好(人工智能决策组为11.7%)。这意味着,人类做最终决策时更注重避免“错误地放贷给实际不会还款的人(借钱给了还不起款的人)”。人类与人工智能的目标不尽一致,可能是造成人们不愿意采纳人工智能辅助的原因。 人工智能可以拉平人类决策能力的差距 人工智能在对劳动力的替代或者辅助过程中可能会影响劳动力市场内部的平等性。平等性直接影响着劳动力市场的稳定和公平,是在效率维度之外极为重要的考虑维度。该课题关注的是,人工智能辅助人类决策的时候是否增加或者降低了劳动效率的不平等?不同的劳动者有着不同的技能水平,对人工智能也有不同的态度,他们在人机结合进行决策的过程中的获益程度可能将有所不同。 图2的实线展示了决策者自己决策(横轴)和有算法辅助决策(竖轴)下决策准确率的关系。我们发现与完全替代人类劳动力不同,人工智能辅助人类决策的情境下,可能会降低决策者之间表现的不平等性:原来表现欠佳的决策者提升更多,原来表现优秀的决策者提升更少,甚至变差。图2的实线展示了决策者自己决策(横轴)和有算法辅助决策(竖轴)下决策准确率的关系。我们发现与完全替代人类劳动力不同,人工智能辅助人类决策的情境下,可能会降低决策者之间表现的不平等性:原来表现欠佳的决策者提升更多,原来表现优秀的决策者提升更少,甚至变差。图2显示,大约有25%的决策者在有人工智能辅助的情形下,准确率反而变低。 图2 人工智能决策与人类决策准确率  如何理解这种现象?首先,个人决策做得好的决策者由于原本的决策质量已经相对较高,人工智能的辅助作用相对有限。但是好的决策者在接受到人工智能信息辅助后反而会变差,这是一个出人意料的现象。我们发现这一现象主要是由决策者没有在人类-人工智能决策中赋予人工智能信息足够的权重导致的。我们将决策者对人工智能信息的权重提高至最优水平,计算出调整后的准确率。在图2,红色实心点代表原始数据,蓝色空心点代表调整后的数据。可以看到,蓝色空心点相比于红色实心点发生了向上平移,绝大部分数据点都移至45度线以上。也就是说,如果人们更多地参考人工智能给出的建议,人类-人工智能合作决策可以提高绝大多数人的决策效率。

文章分类:

行业资讯

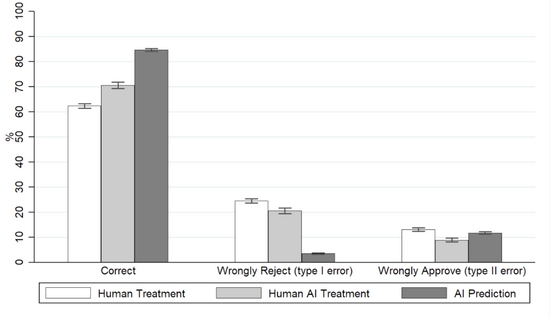

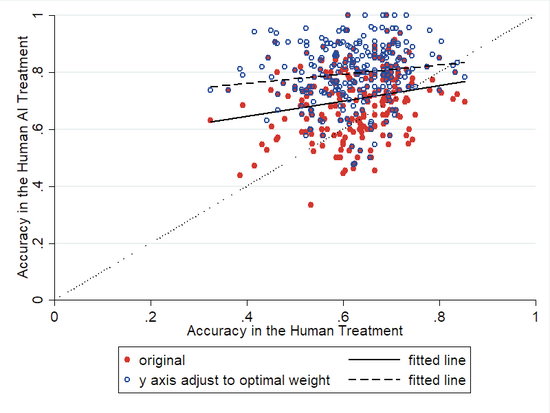

|